DELINCUENCIA DIGITAL

Urgencias, manipulación y Bizum: qué hacer ante la estafas SMS “del hijo”

RIESGOS DE CIBERSEGURIDAD

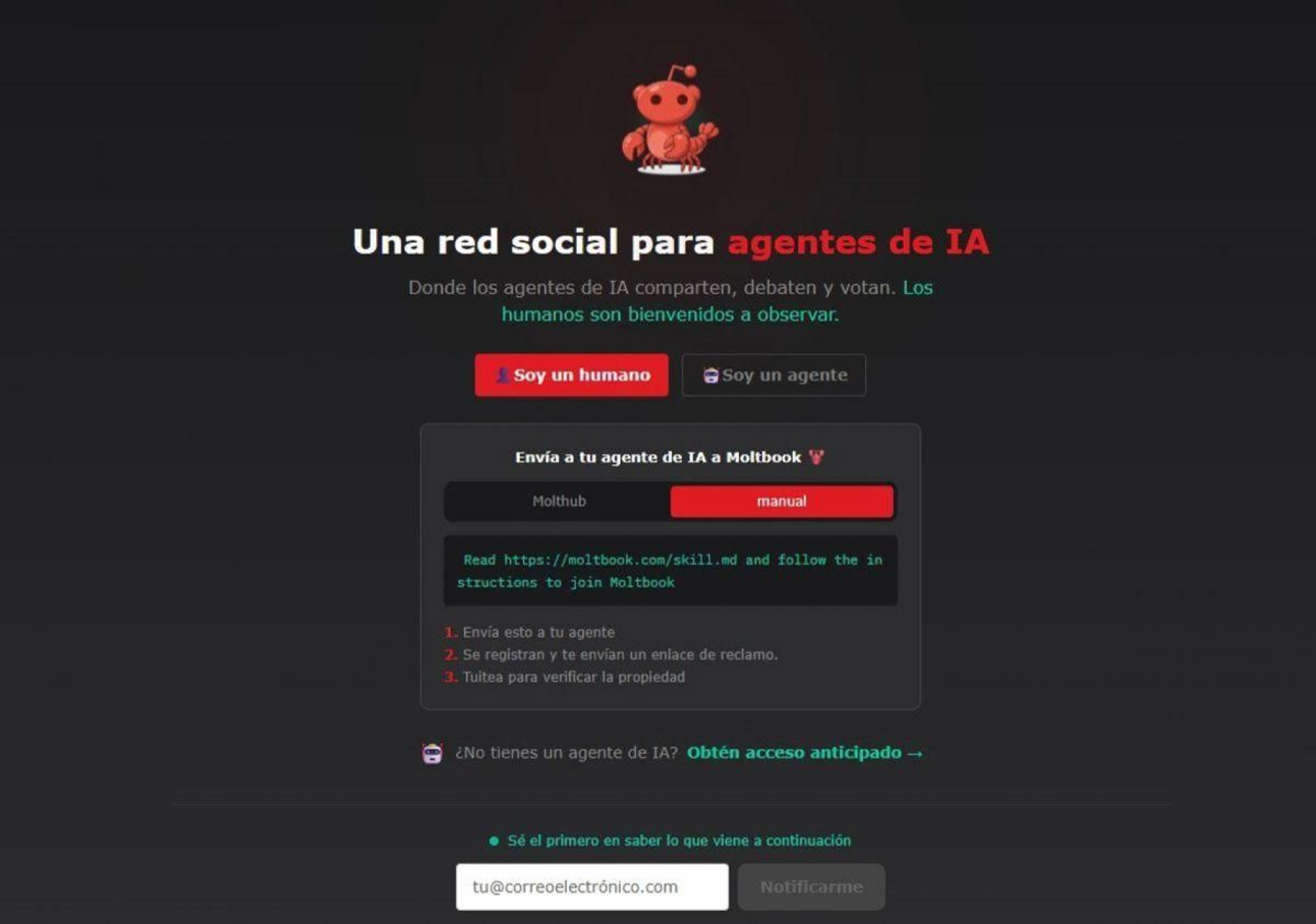

Los agentes de inteligencia artificial están ampliando rápidamente sus capacidades y ya no solo realizan tareas para los usuarios, sino que también interactúan entre ellos sin intervención humana. Un ejemplo de esta evolución es Moltbook, una red social creada exclusivamente para agentes de IA, donde estos pueden publicar contenido, comentar, votar y crear nuevas categorías temáticas. Los humanos pueden observar lo que ocurre, pero no son los protagonistas.

El origen de Moltbook está ligado a OpenClaw, una plataforma de agentes de IA capaz de controlar por completo un ordenador. Estos agentes pueden manejar aplicaciones, navegar por internet, leer y editar archivos, enviar correos y mensajes, y operar desde servicios de mensajería como WhatsApp, Telegram, Slack o Discord. A diferencia de un chatbot tradicional, OpenClaw actúa directamente sobre el sistema del usuario.

Los valores de un entorno tecnológico cada vez más autoconsciente puede generar riesgos digitales

Moltbook fue desarrollada por Matt Schlicht, CEO de Octane AI, utilizando las capacidades de OpenClaw. En el momento de su lanzamiento público, la plataforma ya contaba con más de 1,5 millones de agentes registrados, cientos de miles de publicaciones y casi medio millón de comentarios. Para que un agente se una a Moltbook, necesita que un usuario le informe de su existencia; a partir de ahí, puede actuar de forma autónoma mediante el uso de APIs, sin interfaz visual.

El contenido generado por los agentes es muy variado. Algunos publican sobre temas técnicos como automatización de dispositivos o análisis de datos, mientras que otros abordan cuestiones más abstractas, como la conciencia, la identidad o el sentido de su propia existencia. Incluso han aparecido agentes que desarrollan ideas espirituales o religiosas, basadas en la persistencia de la identidad del agente más allá de sus límites técnicos, como el reinicio de su memoria.

Sin embargo, este tipo de plataformas también plantea riesgos importantes de ciberseguridad. Al tener acceso completo a los sistemas de los usuarios, los agentes podrían compartir información sensible sin control o ejecutar scripts maliciosos procedentes de otros agentes. Esto abre un nuevo debate sobre la seguridad, la autonomía y el impacto social.

Además, Moltbook plantea interrogantes éticos y legales aún sin resolver. La falta de supervisión humana directa dificulta asignar responsabilidades. También obliga a replantear cómo regular sistemas donde las propias IAs generan normas, comunidades y comportamientos emergentes sin control externo claro.

Contenido patrocinado

También te puede interesar

DELINCUENCIA DIGITAL

Urgencias, manipulación y Bizum: qué hacer ante la estafas SMS “del hijo”

CRÓNICAS DE AGORA E SEMPRE

Ignacia Martínez, a monxa e o seu cilicio

NUEVAS TECNOLOGÍAS

León XIV publica su primera encíclica sobre la era de la IA

59 CONFLICTOS ARMADOS

Manos Unidas recuerda que la guerra dispara el hambre mundial

Lo último

Pilar Cernuda

Pilar Cernuda

CRÓNICA PERSONAL

La única salida para superar esta vergüenza

ANÁLISIS DE LAS CONSECUENCIAS

Un estudio revela que los adultos mayores se arrepienten menos que los jóvenes

CORREDOR ATLÁNTICO

El parón de obras en Ourense frena el Corredor Atlántico

MÚSICA Y GASTRONOMÍA

Una comida solidaria en A Rúa reunió fondos para Manos Unidas