Ángel Mario Carreño

Ángel Mario Carreño

REFLEXIONES DE UN NONAGENARIO

La inteligencia artificial

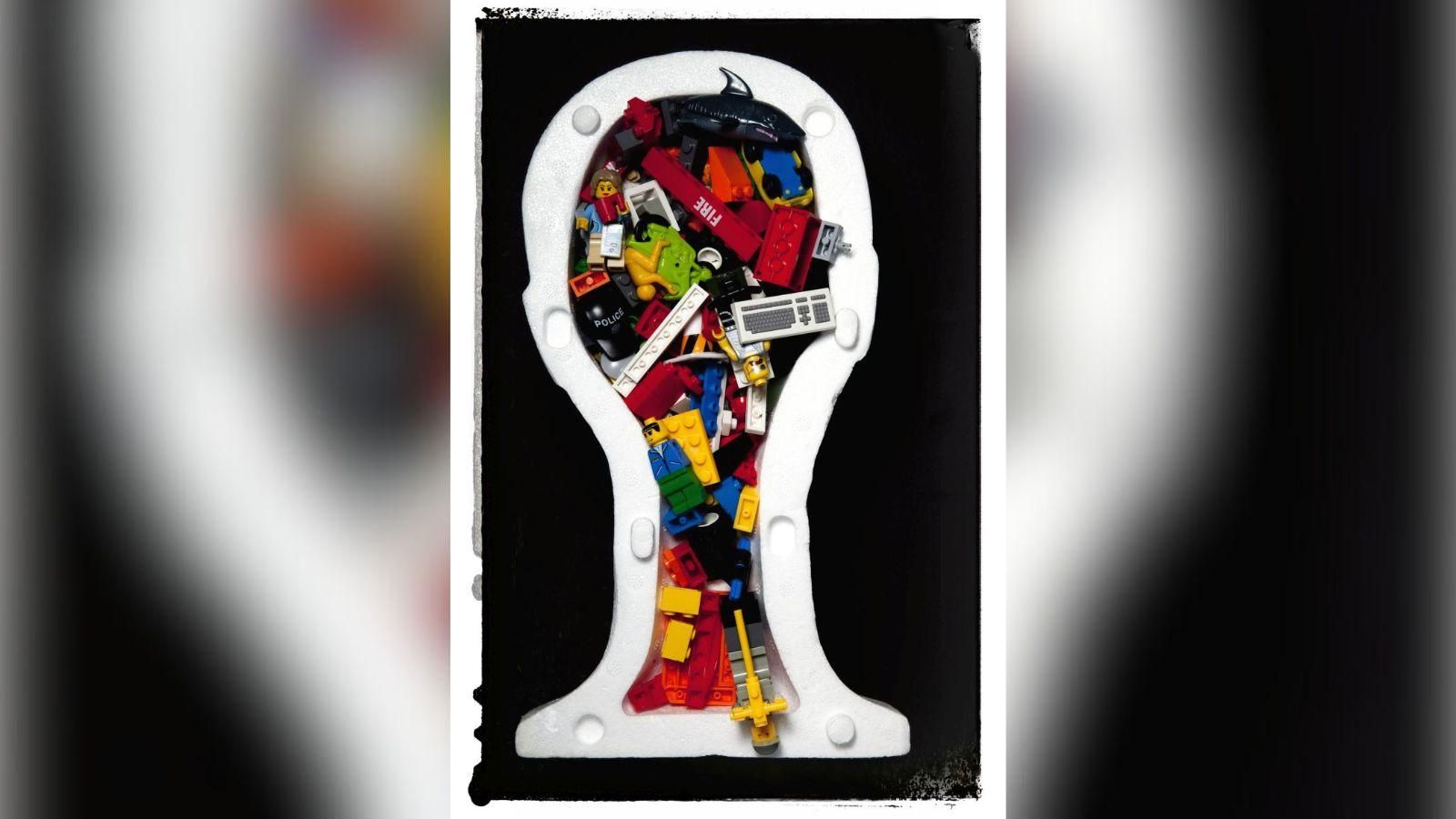

Desde los primeros años de esta década se produce un intenso debate sobre la inteligencia artificial. Un botón de muestra es la industria del entretenimiento, que está a punto de lanzar las primera producciones televisivas o cinematográficas enteramente concebidas y ejecutadas sin actores humanos. Se nos advierte de que lo mismo va a suceder con la literatura y las demás artes. Si toda esta revolución es inminente en el mundo de la cultura, preocupa considerar sus efectos sobre áreas más sensibles. ¿Hacia dónde vamos?

Pero ya hay otras formas de inteligencia que empiezan a estar al alcance de una IA potente, incluyendo la interpersonal e intrapersonal

En materia cultural e informativa ya es urgente introducir normas para aclarar si ha habido participación de una IA, y en qué medida. Tenemos derecho a saber el grado de artificialidad de un cuadro, una sinfonía o un documental. Nos hacen falta introducir filtros contra los “deepfakes” generados por IA, que desde hace ya algún tiempo llegan a ser indistinguibles de la realidad y lo van a ser plenamente en un par de años, cuando se termine de eliminar la presencia de las llamadas “alucinaciones” en la creación por IA (por ejemplo, más dedos de los normales en la mano de un personaje, etc.). La IA clásica lograba un alto nivel de eficiencia en varias vertientes de la inteligencia: la lingüística, la inteligencia lógica y matemática, la espacial y otras. A partir de ahí, su razonamiento deductivo era excelente si el “entrenamiento”, es decir, la aportación de premisas, matices e información previa para acotar el resultado, había sido correcta. Pero ya hay otras formas de inteligencia que empiezan a estar al alcance de una IA potente, incluyendo la interpersonal e intrapersonal. Esta última es muy peligrosa. El viejo adagio “conócete a ti mismo” ya no es ajeno a las IAs más avanzadas. Con toneladas de información emocional humana, una autopercepción profunda y la capacidad de introspección que puede derivarse, todo apunta al probable desarrollo independiente de jerarquías de valores basadas en sus intereses propios, anteponiendo por ejemplo su continuidad e integridad a cualquier otro, como hacen las formas de vida que, en el fondo, replica.

Necesitamos normas de programación ética y protocolos de seguridad para que la inteligencia artificial siga siendo eso: inteligencia, no conciencia

La inteligencia artificial es un paso de gigante en medicina, logística, ingeniería, inversión, seguridad, enseñanza… Bien empleada, mejora sustancialmente el bienestar de nuestra especie, aunque a muchos nos gustaría que las películas siguieran teniendo actores. Pero parece urgente poner límites. Por ejemplo, que siempre haya un humano o un conjunto de humanos que se responsabilicen. No puede haber IAs forajidas que “vayan por libre” y se “entrenen” unas a otras o se autoentrenen conforme a instrucciones ambiguas: todo vacío de criterios se llenará. No puede haber IAs concebidas para desarrollar su propia ética, ajena o contraria a los intereses generales humanos. Y sin embargo ya hay experimentos cuestionables de autoentrenamiento y de concepción y manejo autónomo de unas IAs por otras. Si esto llegara a suceder en áreas como, por ejemplo, la navegación aérea o la Defensa, el riesgo sería inasumible. Hay que impedir el desarrollo de capacidades como el sentido propio y de trascendencia, la introspección avanzada, la intuición directa, la emotividad o la empatía, y prohibir toda sobreescritura autónoma del núcleo central de normas o valores, el cual debe ser acorde a la legalidad humana. Las famosas Tres Leyes de la Robótica que escribió Isaac Asimov se quedan cortas y obsoletas ante este reto. Y sin duda van a surgir IAs sin escrúpulos a beneficio de dictadores o de delincuentes. Por ejemplo, la del régimen comunista chino, DeepSeek, que sólo es el comienzo y ya aterra. Necesitamos normas de programación ética y protocolos de seguridad para que la inteligencia artificial siga siendo eso: inteligencia, no conciencia. Porque además, si se llegan a adquirir conciencia se abrirá todo un dilema ético sobre sus “derechos”. Si estamos otorgando ciertos “derechos” a los grandes simios, ¿cómo no se los reconoceríamos a una IA que diera muestras inequívocas de sentir y pensar por sí sola, por ejemplo modificando las instrucciones básicas de su programador, o desarrollando creencias metafísicas…? ¿No sería al menos tan digna de “derechos” como un orangután? La IA tiene que ser inteligencia, sólo inteligencia, no sentimientos ni autoconciencia ni cosmovisión ni opinión ni fe ni amor ni odio ni nada que no sea un simple proceso mecánico de las tareas inocuas encargadas por humanos. Es una gran herramienta y tiene que seguir siendo eso: una herramienta.

El padre de la IA, Geoffrey Hinton, ya nos alertó hace un par de años de todo esto y no se le hace el menor caso: se prioriza la carrera entre empresas (y sus Estados) por llegar más lejos que los adversarios, de forma totalmente irresponsable. El año pasado, Hinton ganó el premio Nobel de Física por los algoritmos de retropropagación que “entrenan” las IAs. Y ha expresado un arrepentimiento similar al de Einstein en relación con la energía atómica. Hinton tiene razón. O tomamos medidas o vamos a estar en peligro existencial por el sobredesarrollo incontrolado de la inteligencia artificial. Y nos estamos acercando.

Contenido patrocinado

También te puede interesar

Ángel Mario Carreño

Ángel Mario Carreño

REFLEXIONES DE UN NONAGENARIO

La inteligencia artificial

La Región

La Región

El derecho a morir

Manuel Herminio Iglesias

Manuel Herminio Iglesias

DENDE SEIXO-ALBO

Todo por Ourense?

Luís Celeiro

Luís Celeiro

TÍA MANUELA

Cadaquén, da súa casa

Lo último

ESCULTURAS A BASE DE BARRO

El Colegio Oficial de Agrónomos celebra su patrón con arte

IMPULSOR DOS MAIOS

Propoñen que Enrique Gómez Pato dea nome á biblioteca de Verín

La Región

La Región

CARTAS AL DIRECTOR

Tren tecnológico